Según NewsGuard, una organización dedicada a rastrear desinformación online en EE.UU., desde mayo de 2023 hubo un vertiginoso aumento en la propagación de artículos falsos generados por inteligencia artificial (IA), revelando una preocupante realidad en la esfera informativa. Así, lograron identificar la proliferación de 603 sitios de noticias generados por IA, operando con mínima supervisión humana, marcando una drástica escalada desde los modestos 49 sitios previos que se habían detectado.

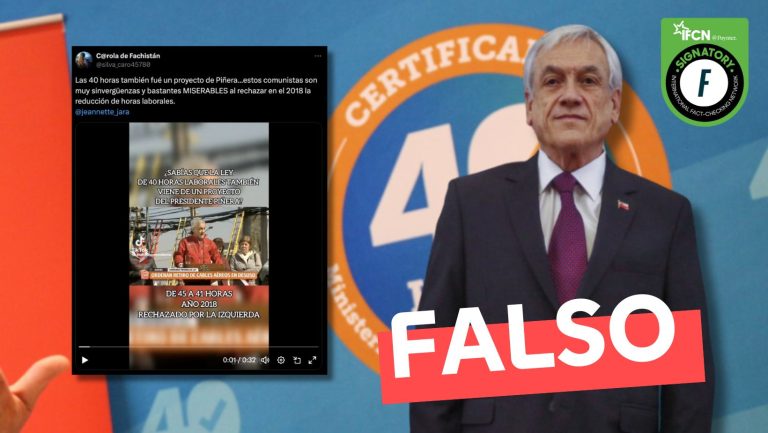

Según el Washington Post, históricamente, las operaciones de propaganda han dependido de ejércitos de trabajadores u organizaciones de inteligencia altamente coordinadas para construir sitios que parezcan legítimos. Pero la inteligencia artificial está facilitando que casi cualquier persona pueda crear estos medios, generando contenido que es difícil de diferenciar de las noticias reales.

El impacto transformador de la IA en la fabricación de contenido falso

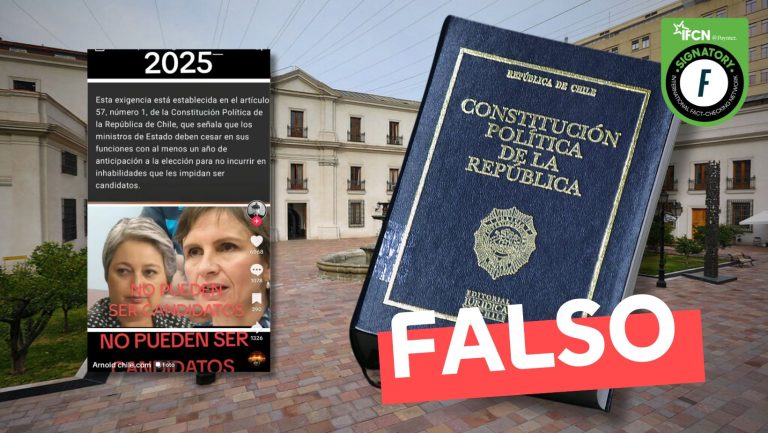

Este fenómeno subraya el impacto transformador de la implementación de herramientas de IA, no solo en las llamadas “granjas de contenido”, sino también en los propagadores de desinformación. La difusión de narrativas falsas sobre elecciones, guerras y desastres naturales ha alcanzado nuevas cotas de facilidad. Entonces, ¿qué sucede con los lectores incautos? La mayoría de las personas carece del discernimiento necesario para separar la verdad de la falsedad en este creciente mar de información manipulada, planteando riesgos considerables para la sociedad.

¿Cómo identificar estos sitios?

Usualmente estas páginas web adoptan nombres genéricos para engañar, como “iBusiness” “Day” o “Ireland Top News”, ocultando su verdadera naturaleza detrás de una apariencia que pretende inspirar confianza. NewsGuard aconseja a los lectores estar atentos a señales reveladoras, como mensajes de error o lenguaje específico de respuestas de chatbot, que indican la producción de contenido por parte de IA sin la supervisión editorial necesaria.

Un vívido ejemplo

Un artículo generado por inteligencia artificial contaba una historia inventada sobre el psiquiatra de Benjamin Netanyahu, primer ministro de Israel, alegando que había fallecido y dejado una nota sugiriendo la implicación de Netanyahu en el suceso. La narración fue destacada en un programa de televisión iraní y luego se comenzó a difundir en sitios de medios en árabe, inglés e indonesio, además de ser compartida por usuarios en TikTok, Reddit e Instagram.

La trampa de la publicidad programática

NewsGuard señala con firmeza la responsabilidad compartida de las marcas que, al anunciar prácticamente en cualquier lugar, contribuyen al crecimiento de estos sitios. El modelo de ingresos basado en la publicidad programática, sin considerar la calidad del sitio, alimenta inadvertidamente la maquinaria de la desinformación. A menos que las marcas adopten medidas decisivas para excluir sitios no confiables, sus anuncios seguirán creando un peligroso incentivo económico para la proliferación de estas fuentes manipuladas.

Desafíos críticos precediendo las elecciones de EE.UU 2024

El aumento alarmante de sitios que producen contenido falso plantea desafíos críticos en la antesala de las elecciones presidenciales de EE.UU en 2024, amenazando con influir de manera sustancial en el destino de los candidatos políticos. Al respecto y aunque las redes sociales ya están saturadas de desinformación, Meta, la empresa matriz de Facebook, Instagram y WhatsApp, ha tomado medidas proactivas al prohibir el uso de productos publicitarios generativos de IA para campañas políticas, estableciendo una barrera crucial contra la propagación de la desinformación en estas plataformas.