Cada vez cuesta más distinguir si una imagen está creada con inteligencia artificial. Lo mismo ocurre con los videos o audios cuando están inventados e igualan la apariencia y el sonido de una persona. En este blog te presentamos algunas herramientas que te pueden ayudar a identificar si estas frente a un deepfake.

Por Fast Check

Un deepfake es una imagen, un video o un audio que está creado e imita la apariencia y el sonido de una persona.

Los deepfakes son generados por inteligencia artificial y la mayor parte del tiempo se pueden ver en videos o filtros de realidad aumentada.

De hecho, el término proviene de la combinación de las palabras «deep learning» y «fake», para representar algo falso que es resultado de la tecnología de aprendizaje profundo, según Seon.

A continuación te presentamos 5 herramientas que puedes utilizar para detectar y no caer en deepfakes.

1) TensorFlow y PyTorch

TensorFlow y PyTorch son dos ejemplos de herramientas gratuitas que emplean redes neuronales profundas para detectar deepfakes.

Pero, ¿qué es una red neuronal profunda? Esta es una técnica de aprendizaje automático que permite a un computador, mediante su entrenamiento, realizar funciones que serían muy difíciles de llevar a cabo utilizando técnicas de programación convencionales, según Botpress.

Los algoritmos de redes neuronales se inspiraron en el cerebro humano, están diseñados para funcionar no solo siguiendo una lista preestablecida de reglas, sino prediciendo soluciones y sacando conclusiones basadas en repeticiones y experiencias anteriores.

TensorFlow

Es una plataforma para construir y entrenar redes neuronales, que permiten detectar y descifrar patrones y correlaciones, similares al aprendizaje y razonamiento usados por los humanos, según la descripción del mismo sitio.

¿Cómo funciona la aplicación para reconocer una imagen? En este caso se pueden encontrar capas de entrada y de salida. Las redes neuronales van aprendiendo automáticamente. Memorizan representaciones cada vez más abstractas de los datos que reciben de las imágenes. Las neuronas detectan líneas, formas y texturas, entre otras cosas, para reconocer una imagen, objeto, etc.

También, se puede utilizar para analizar videos y pistas de audio con el fin de detectar indicios de manipulación. Los usuarios solo tienen que subir ejemplos de contenidos reales y falsos para entrenar un modelo de detección que sea capaz de diferenciar entre ambos.

PyTorch

Es un marco de código abierto para aprendizaje automático, y se basa en el lenguaje de programación Python y la biblioteca de la Antorcha. Fue desarrollado en 2016 por un equipo de investigadores para inteligencia artificial por Facebook para mejorar la eficiencia del desarrollo y despliegue de prototipos de investigación. PyTorch computa con tensores, que se aceleran mediante procesadores gráficos. El framework permite realizar más de 200 operaciones matemáticas diferentes.

2) Deepware

Es una aplicación que se utiliza para el análisis y detección de videos deepfake. El uso de la herramienta es gratuito, se utiliza desde el navegador sin tener que instalar programas y no necesita registro.

¿Cómo se utiliza?

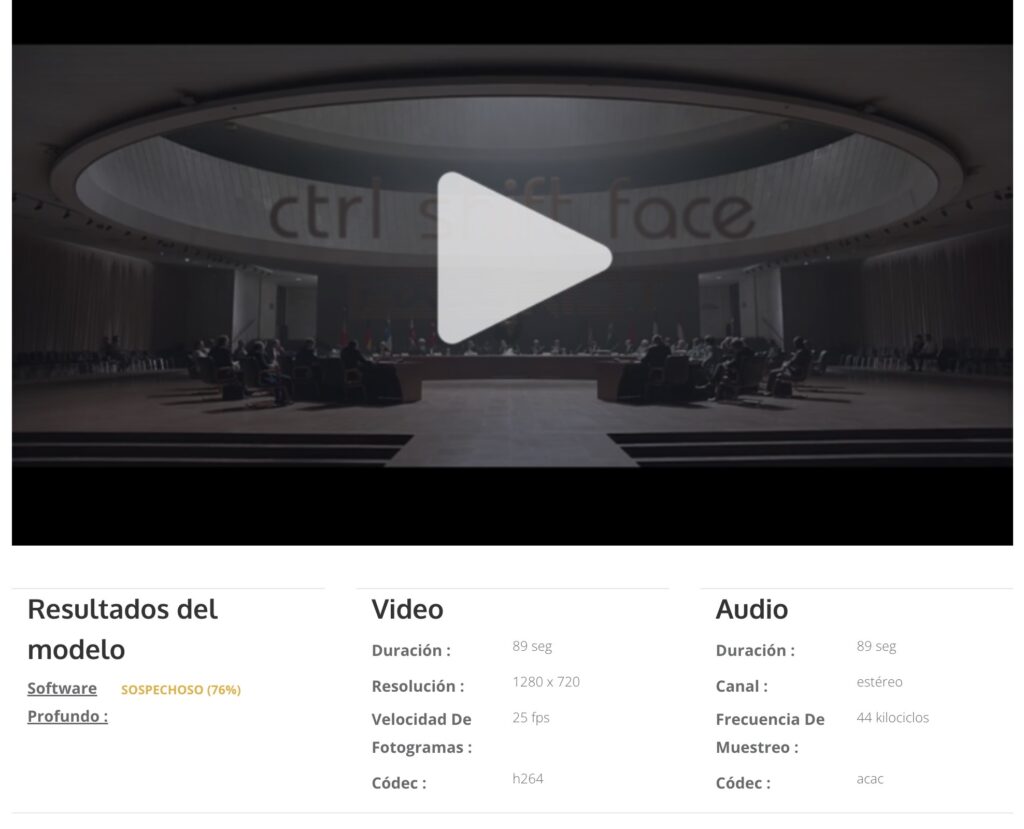

Todo lo que debes hacer es escribir o pegar la URL del video, hacer clic en el botón “SCAN” y esperar los resultados.

También puedes usarla para analizar videos que no están almacenados en Internet. Solo tienes que cargar la grabación que quieres analizar y seguir los pasos anteriores, es decir, pulsar en “SCAN” y esperar los resultados.

Colocamos este video: https://www.youtube.com/watch?v=cxnsIUDpi-g&t=57s y el resultado fue “sospechoso (76%)”.

Al igual que otros detectores de deepfakes, los modelos de deepware buscan signos de manipulación en el rostro humano. La principal limitación de la herramienta es su incapacidad para detectar técnicas de sustitución de voz.

3) Sensity

Esta herramienta está especializada en la detección de deepfakes y de imágenes generadas por inteligencia artificial (IA). Lo que permite la aplicación es analizar señales visuales y contextuales para identificar IA.

La herramienta no es gratuita; las tarifas dependen del uso mensual y las áreas de interés individuales.

4) Hive

Con esta aplicación, tanto textos como imágenes digitales se pueden escanear para comprobar su identidad. Para chequear una imagen, los usuarios suben un archivo a la sección de detección de contenidos generados por IA para que sea procesado rápidamente.

También existe la extensión para Chrome Hive AI Detector, que permite a los usuarios detectar gratuitamente texto e imágenes generados por IA desde el navegador, según Ijnet (Red Internacional de Periodistas)

5) Illuminarty

Por último, está Illuminarty, la cual también ofrece la posibilidad de detectar imágenes y texto generados por IA.

Con esta aplicación, los usuarios pueden identificar dónde está exactamente la manipulación en una imagen falsa y a partir de qué modelos de IA se ha generado.

Cabe recordar que todas las herramientas mencionadas en este blog, ayudan a combatir los deepfakes, pero no son 100% precisas, según Ijnet.

Por último, un punto que hay que tener en cuenta a la hora de detectar un deepfake es observar la imagen, el video o el audio. Generalmente, los contenidos hechos con IA no son perfectos: Fíjate en el parpadeo de los ojos, el rostro, el cuello y siempre cuestiónate la fuente de procedencia.